发布时间:2019-08-16 阅读量:685 来源: 智东西 发布人: Jane

据外媒报道,Nvidia今天宣布,它已经训练出了世界上最大的语言模型MegatronLM,该模型使用了83亿个参数,比Bert大24倍,比OpenAI的GPT-2大5倍。

Nvidia还宣布其打破了BERT模型的最快训练时间记录,通过使用优化的PyTorch软件和超过1,000个GPU的DGX-SuperPOD,Nvidia能够在53分钟内训练出行业标准的BERT模型。

除此之外,Nvidia还通过运行Tesla T4 GPU和针对数据中心推理优化的TensorRT 5.1,成功将BERT推理时间降至了2.2毫秒。

一、世界最大语言模型MegatronLM比Bert大24倍

Nvidia今天宣布,它已经训练出了世界上最大的语言模型MegatronLM,这是这家GPU制造商旨在推进会话式AI的一系列更新中的最新版本。、

为了实现这一壮举,Nvidia利用模型并行性,用一种技术将神经网络分割成多个部分,创建出了MegatronLM模型,该模型使用了83亿个参数,比Bert大24倍,比OpenAI的GPT-2大5倍。

Nvidia同时还宣布打破了BERT的最快训练记录,通过使用优化的PyTorch软件和超过1,000个GPU的DGX-SuperPOD,Nvidia能够在53分钟内训练出行业标准的BERT模型。

Nvidia深度学习应用(applied deep learning)副总裁Bryan Catarazano在与记者和分析师的一次谈话中说:“如果没有这种技术,训练这些大型语言模型可能需要数周时间。”

Nvidia还表示它已经实现了最快的BERT推理时间,通过运行Tesla T4 GPU和针对数据中心推理优化的TensorRT 5.1,BERT推理时间能够降至2.2毫秒。

Bryan Catarazano表示,当用CPU进行推理时,BERT推理最多需要40毫秒,而许多会话式AI系统今天会在10毫秒内完成。

▲MegatronLM代码已经在在GitHub上开源

Nvidia已经将MegatronLM代码在GitHub上开源,以帮助人工智能从业者和研究人员探索大型语言模型的创建,或使用GPU进行速度训练或推理。

二、53分钟训练BERT

2018年10月,谷歌正式推出了基于双向 Transformer 的大规模预训练语言模型“BERT”,并在短期内刷新了当时11 项 NLP 任务的最优性能记录。

BERT能高效抽取文本信息并应用于各种 NLP 任务,所以非常适合语言理解任务,如翻译,问答,情感分析和句子分类等。

Nvidia本次用带有92个DGX-2H节点的NVIDIA DGX SuperPOD在短短53分钟内就成功训练BERT-Large,这创造了新的记录。

为了实现这个新纪录,Nvidia用了1,472 个V100 SXM3-32GB 450W GPU和每个节点8个Mellanox Infiniband计算适配器以自动混合精度( Automatic Mixed Precision)运行PyTorch以加快处理数量和速度。

▲不同数量的GPU训练BERT-Large的时间

相比之下,对于只能访问单个节点的研究人员来说,使用16个V100的DGX-2服务器训练BERT-Large需要3天。

结语:MegatronLM模型促进NLP发展

让计算机理解人类语言及其所有细微差别并做出适当反应一直是AI研究人员追求的方向,但在现代AI技术的到来之前,建立具有真正NLP功能的系统是不可能的。

随着BERT和具有10亿多参数的GPT-2模型等大型语言模型的出现,我们看到了高难度语言理解任务实现的可能,而Nvidia本次发布的MegatronLM模型更是将NLP处理提高了一个台阶。

更重要的是,新的模型可能会减少像亚马逊Alexa、Google Assistant和百度Duer这样的语音助手交互延迟时间,这对于语音交互实际的发展有非常大的推动作用。

文章来源:Venturebeat、Nvidia

在USB4®和Thunderbolt™接口传输速率突破10GHz的产业背景下,静电放电(ESD)和意外短路引发的系统失效已成为消费电子与通信设备的核心痛点。传统保护方案在射频性能与防护强度间的取舍矛盾,特别是不合规Type-C接口中Vbus与TX/RX短路风险,迫使行业寻求突破性解决方案。Nexperia最新推出的五款1V保护二极管,通过创新架构实现鱼与熊掌兼得的技术跨越。

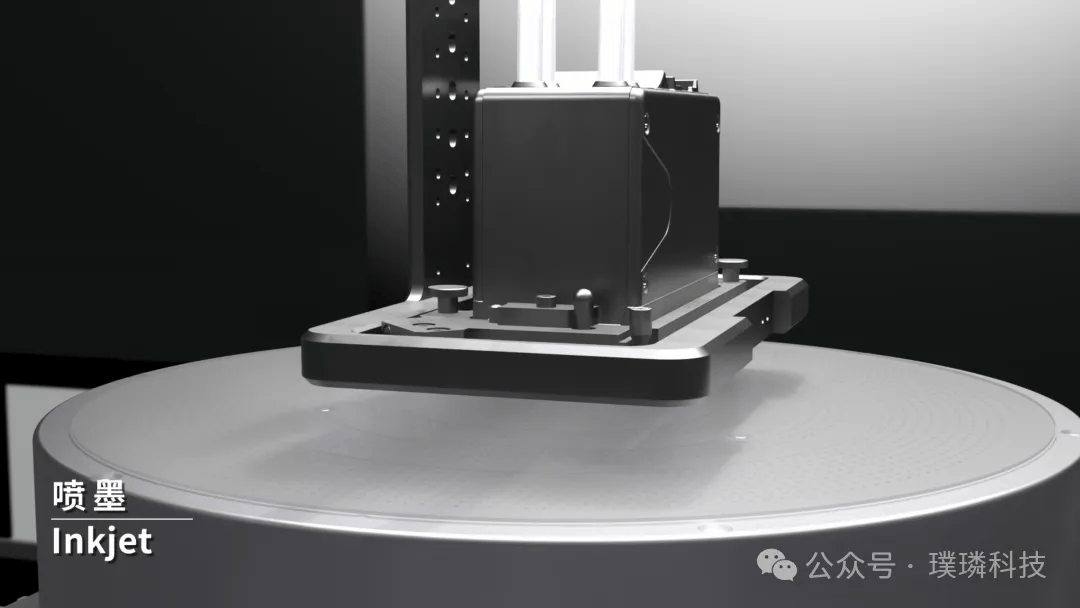

2025年8月1日,璞璘科技自主研发的首台PL-SR系列喷墨步进式纳米压印设备正式通过验收并交付国内特色工艺客户。该设备攻克了步进硬板非真空贴合、喷胶与薄胶压印、压印胶残余层控制等关键技术,标志着我国在高端半导体装备领域取得实质性突破。

全球晶圆代工龙头企业台积电在推进2nm先进制程量产的关键阶段,于内部安全审查中发现异常活动。公司声明显示,其监控系统侦测到未经授权的技术信息访问行为,已对涉事人员解除雇佣关系,并启动法律程序追责。

在2025年8月4日,全球领先的半导体解决方案供应商Onsemi正式发布了其2025年第二季度财务报告。本季度,公司展现了稳健的经营表现,反映其在功率半导体领域的战略优势。随着汽车电子化和人工智能应用的加速渗透,Onsemi通过持续优化业务模式,在充满变化的市场环境中取得可喜进展。

据Counterpoint Research近期发布的报告,2025年第二季度,全球智能手机市场呈现显著收入增长,总收入达1000亿美元以上,同比提升10%。这一数据创下了自统计以来第二季度的收入新高峰。尽管出货量仅同比增长3%,不足总量的显著跃升,但市场动能源于平均售价(ASP)的大幅上涨。报告显示,本季度ASP同比增长7%,达到约350美元的历史高位,反映出消费者对高端设备的强劲需求推动了整体盈利能力提升。这种收入与出货量的差异化增长,突显了市场结构正加速向高端化转变。